La prochaine frontière de l'IA : les politiques, les infrastructures et les alliances industrielles redéfinissent le paysage technologique en 2025

Author: Editorial Team

Des salles de conseil aux halls du gouvernement, le récit de l'IA en 2025 n'est plus une seule histoire technologique mais une tapisserie de politiques, d'infrastructures et de stratégie de marché. Alors que les laboratoires repoussent les limites de l'apprentissage automatique, les dirigeants de l'industrie avertissent d'une menace émergente : la cybercriminalité alimentée par l'IA qui pourrait dépasser les défenses traditionnelles. Pendant ce temps, les entreprises de matériel s'efforcent de proposer des accélérateurs plus rapides et plus économes en énergie, et les bâtisseurs de nuages et de data centers préparent la prochaine vague de capacité pour répondre à une demande croissante. Dans ce paysage, les collaborations transfrontalières, les débats réglementaires et les programmes industriels ambitieux convergent pour déterminer à quelle vitesse l'IA peut être déployée, et à quel coût en sécurité et fiabilité. Cet article synthétise les idées issues des développements dans l'écosystème technologique — des appels à des lois plus strictes sur la cybercriminalité à l'émergence de plateformes de développement d'IA modulaires, et des importants partenariats matériels à l'expansion de l'infrastructure IA dans les économies qui s'accélèrent.

Les titres politiques et de sécurité se précisent alors que les experts appellent à un cadre juridique contre la cybercriminalité alimentée par l'IA. Les reportages de Businessworld soulignent une urgence croissante parmi les dirigeants du secteur à renforcer les lois et à favoriser la coopération internationale pour freiner la fraude, le phishing et d'autres crimes alimentés par l'IA. Les propositions vont de la clarification de la responsabilité en matière de tromperie générée par l'IA à l'établissement de normes minimales pour la protection des données et la notification des incidents, et à la création de mécanismes d'échange d'informations transfrontaliers qui peuvent accélérer les enquêtes. Le débat survient alors que des réseaux criminels exploitent l'IA pour fabriquer des messages de phishing fortement personnalisés, des deepfakes et des identités synthétiques. Les partisans soutiennent que sans réglementations robustes et harmonisées, les avantages de l'innovation activée par l'IA pourraient être érodés par des risques croissants. Les détracteurs avertissent que les lois doivent équilibrer sécurité et innovation, évitant d'entraver l'expérimentation ou d'imposer des schémas qui entravent la recherche légitime et le déploiement. L'objectif global est d'aligner la politique sur les cycles technologiques rapides, en veillant à ce que défenseurs, entreprises et consommateurs partagent un cadre commun.

Des centaines d'équipes de développement se tournent vers des architectures d'IA modulaires qui promettent des flux de travail plus fiables et évolutifs. La couverture de Hackernoon sur les mises à jour du serveur MCP met en lumière la manière dont les sorties structurées, les techniques d'extraction et les liens vers des ressources deviennent intégrales aux opérations modernes des LLM. Le mouvement vers des piles modulaires—où des composants spécialisés gèrent la perception, le raisonnement et la génération de sortie—permet aux développeurs de recombiner rapidement les capacités, de tester des alternatives et de tracer les décisions de manière plus transparente. Les premiers adopteurs signalent des cycles d'itération plus rapides, une meilleure reproductibilité et une meilleure intégration avec les écosystèmes logiciels existants. Bien que la majorité de ce contenu reste derrière des paywalls, la leçon générale est claire : une approche modulaire et auditable est de plus en plus considérée comme essentielle pour naviguer dans le paysage complexe et hétérogène des outils IA en 2025.

Illustration des flux de travail d'IA modulaires, reflétant la pile au style MCP composée de perception, de raisonnement et de composants de génération de sortie.

MIPS, une entreprise étroitement suivie pour son matériel activé par l'IA, a annoncé la nomination d'Alan Li au poste de directeur du développement commercial pour la Chine. Le parcours de Li dans l'automobile, l'industrie et les infrastructures de communications devrait accélérer la croissance et les partenariats régionaux de MIPS alors que la demande d'accélérateurs d'IA en périphérie se développe à travers l'Asie. Cette décision montre comment les acteurs du matériel s'alignent sur les ambitions IA nationales et régionales, renforçant la tendance à un déploiement coordonné et transfrontalier des capacités d'IA — des ateliers de fabrication aux villes intelligentes — et mettant en évidence l'importance des partenariats locaux pour naviguer les cadres réglementaires et les dynamiques du marché.

Alan Li, nouvellement nommé responsable du développement commercial pour la Chine chez MIPS, signalant une intensification de la stratégie régionale des matériels IA.

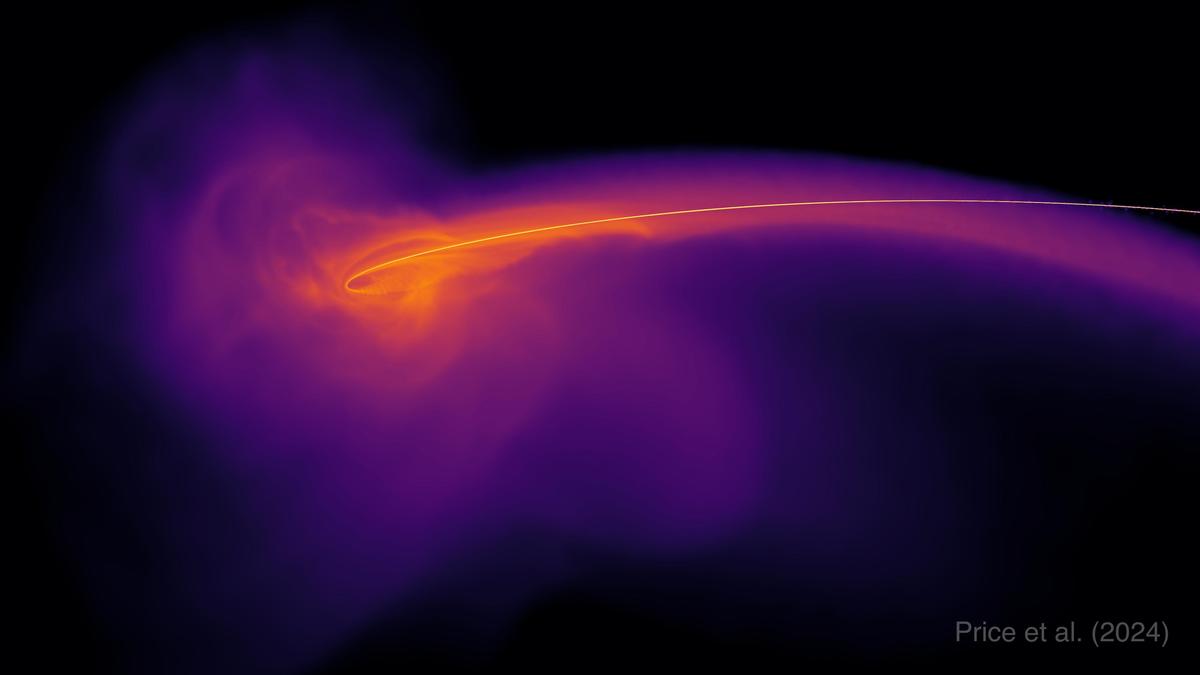

Au-delà du laboratoire et du showroom, la science sous-jacente à l'IA et au calcul continue d’être inspirée par les avancées en physique fondamentale. Le reportage du Hindu sur les transitoires nucléaires extrêmes près des trous noirs — où les étoiles s'étirent, se déchirent et s'énergisent violemment à l'approche des horizons des événements — souligne comment des phénomènes complexes et à haute énergie exigent une modélisation et une analyse de données sophistiquées. Bien qu'il ne s'agisse pas d'un article sur l'IA à proprement parler, une telle science illustre l'échelle et la complexité que les systèmes d'IA cherchent à modéliser, simuler et accélérer. Le croisement entre l'astrophysique, la physique quantique et l'apprentissage automatique aide à développer de nouveaux algorithmes, à améliorer les simulations et à mieux comprendre le flux d'informations dans les systèmes chaotiques.

Simulations astrophysiques de processus énergétiques extrêmes près des trous noirs — un rappel des problèmes de données complexes que l'IA cherche à résoudre.

La concurrence et la coopération dans le domaine du matériel restent au cœur de l'accélération de l'IA. Un titre évoque une collaboration potentielle entre Nvidia et Samsung pour faire progresser la technologie des puces IA et la largeur de bande mémoire grâce à des innovations telles que les mémoires à haute bande passante (HBM). Un autre axe majeur est le partenariat entre Nvidia et Intel pour co-développer plusieurs générations de produits personnalisés pour centres de données et informatique personnelle, reflétant une stratégie plus large visant à diversifier les chaînes d'approvisionnement et à assurer le déploiement rapide des charges de travail IA dans les entreprises et les environnements en périphérie. Ces dynamiques montrent comment les pressions concurrentielles et les alliances stratégiques façonnent la pile matérielle qui sous-tend l'IA moderne — des GPU aux accélérateurs, à la mémoire et aux capacités d'intégration système.

NVIDIA et Samsung font progresser la technologie des puces IA, annonçant une nouvelle phase de la concurrence matérielle en IA.

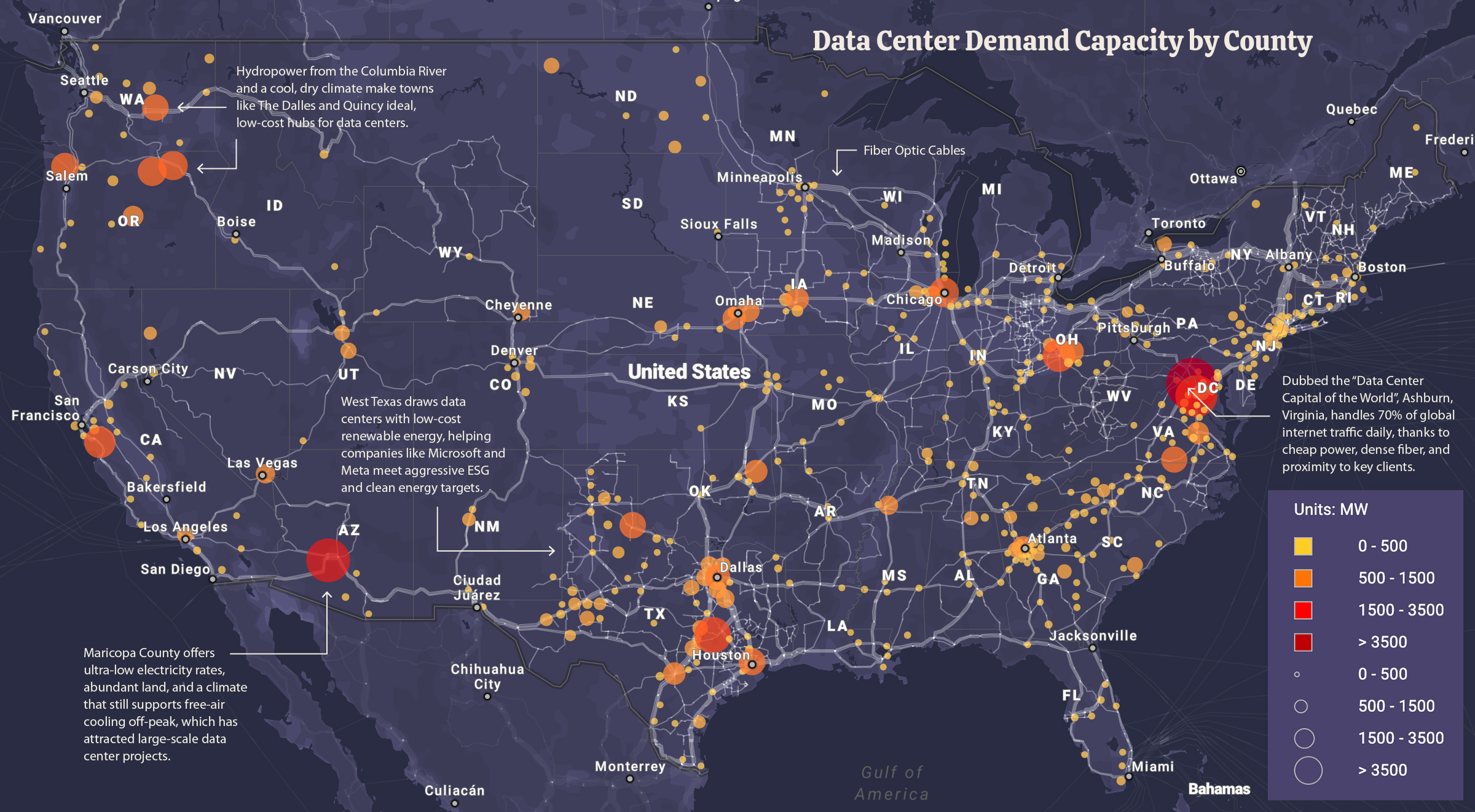

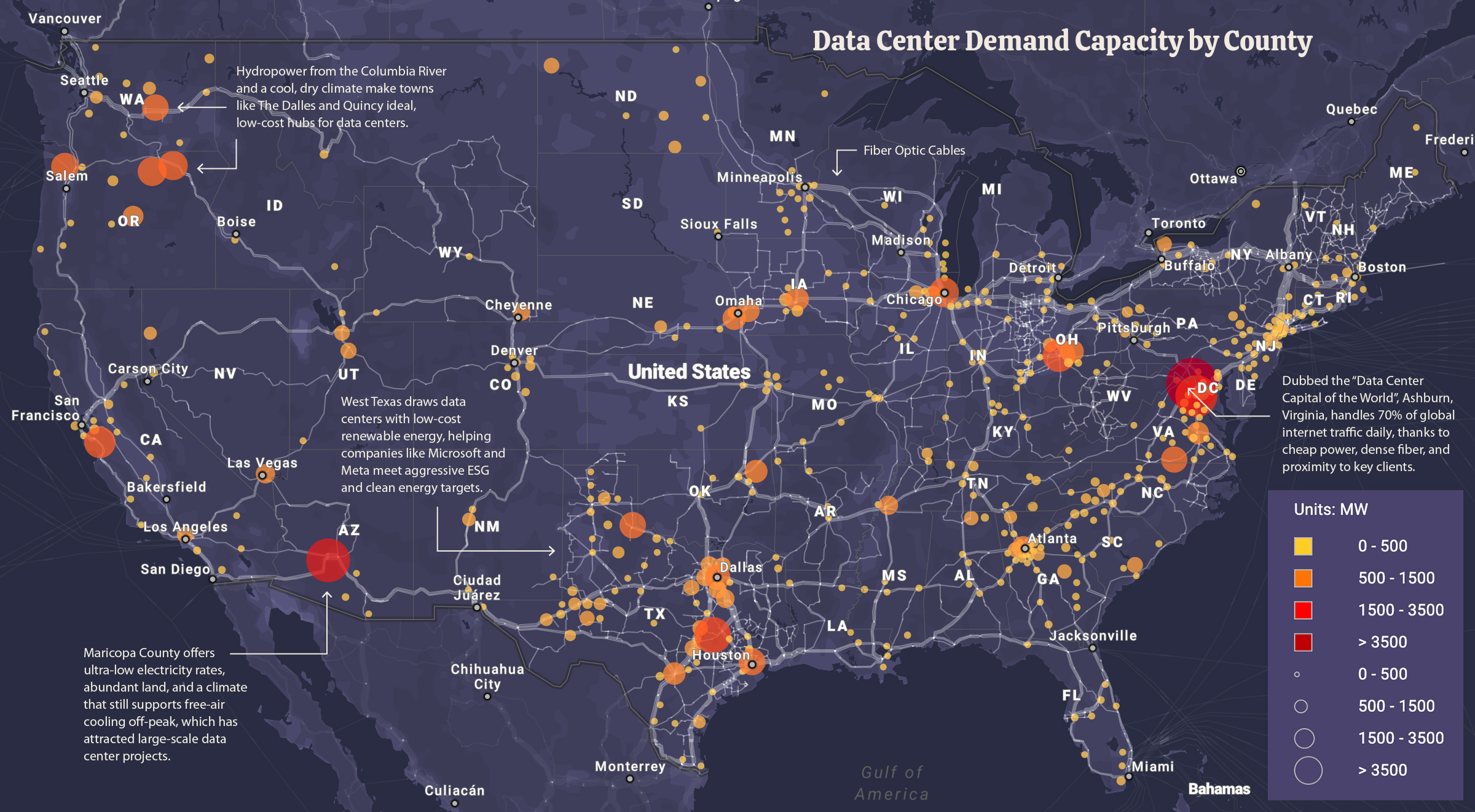

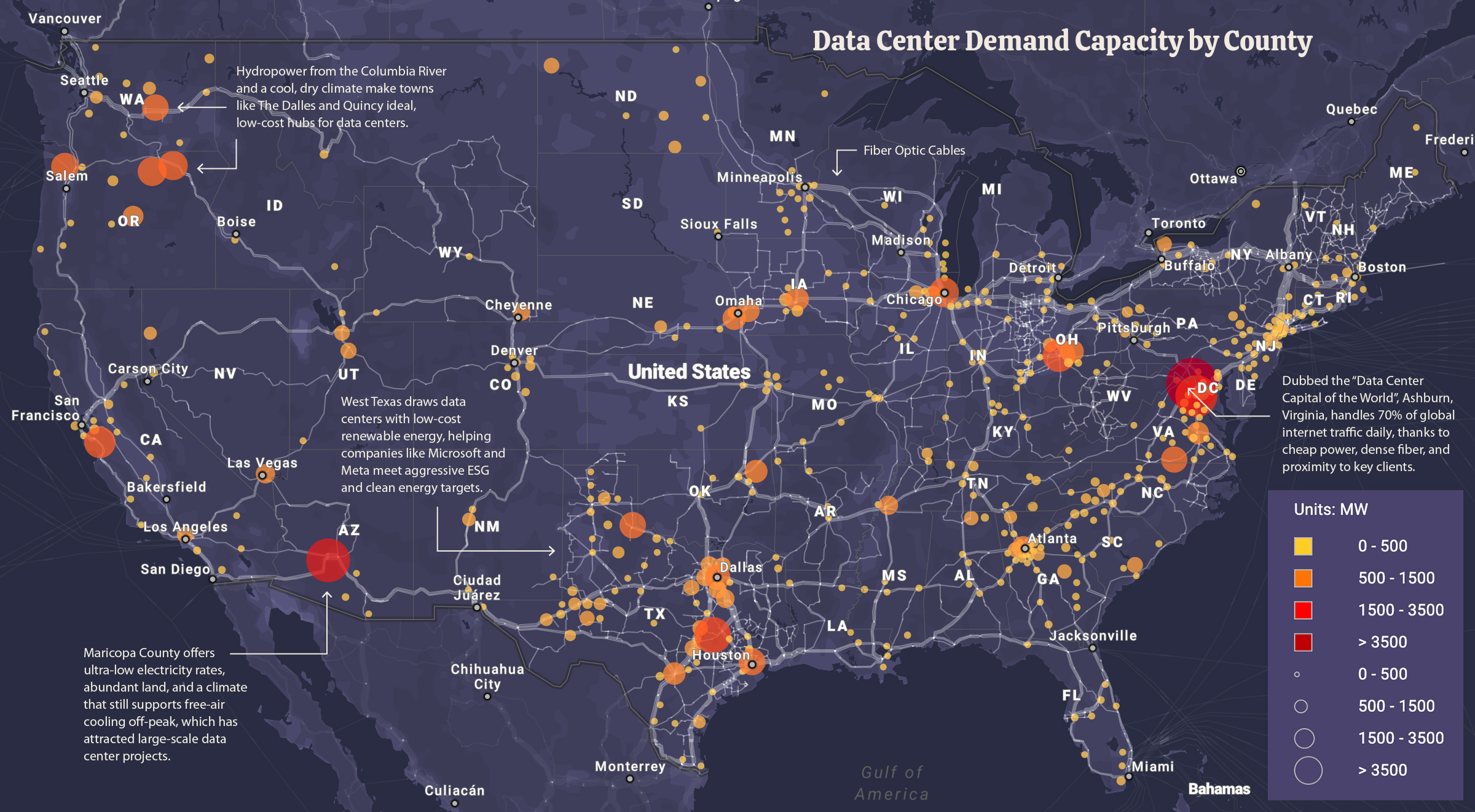

As organisations scale AI, data-center energy consumption has emerged as a critical constraint. Visual Capitalist’s data-center power map and related visualization, discussed in coverage of U.S. data-center energy use, highlights the enormous energy requirements behind modern AI. The information underscores the need for efficiency, wiser capacity planning, and smarter cooling, as data centers could see energy demand doubling by the end of this decade. The related analysis from FinancialContent aggregations also points to the geographic distribution of data-center activity and the strategic importance of location, grid reliability, and policy frameworks that incentivize clean energy and demand-response programs. In short, the infrastructure that makes AI possible is also demanding substantial electrical power, making energy efficiency a central competitive differentiator.

A map highlighting the sprawling energy footprint of data centers powering AI workloads in the United States.

The United Kingdom’s ambitious AI infrastructure push is another major inflection point, with reports suggesting that Microsoft and Amazon are among the primary beneficiaries. The UK government’s sizable investment—on the order of tens of billions—aims to accelerate the deployment of AI-ready infrastructure, data centers, and cloud capacity. For multinational cloud players, this represents a potential rebalancing of cloud economics and a chance to expand regional service capabilities. The development also suggests new opportunities for local AI startups and research institutions to collaborate with global technology giants, leveraging a more connected, data-rich environment to accelerate experimentation and deployment across sectors such as health care, finance, and manufacturing.

Illustrative map of AI-driven infrastructure development and data-center growth in the UK and Europe.

En mesure que ces fils se tissent — garde-fous politiques, architectures d’IA modulaires évolutives, partenariats matériels stratégiques, croissance des centres de données et écosystèmes régionaux en expansion — le paysage technologique de 2025 ressemble moins à un seul cycle de hype et plus à un effort coordonné visant à construire des capacités d’IA robustes, sécurisées et interconnectées à l’échelle mondiale. Les années à venir mettront à l’épreuve si toutes ces pièces peuvent s’aligner : des réglementations qui dissuadent les abus, des écosystèmes matériels et logiciels qui accélèrent l’innovation, et des infrastructures énergétiques et de réseau capables de soutenir une économie numérique qui s’appuie sur l’IA pour accroître la productivité dans tous les secteurs.