La próxima frontera de la IA: políticas, infraestructura y alianzas industriales redefinen el panorama tecnológico en 2025

Author: Editorial Team

Desde las salas de juntas hasta las salas gubernamentales, la narrativa de la IA en 2025 ya no es una única historia tecnológica, sino un tapiz de políticas, infraestructura y estrategia de mercado. A medida que los laboratorios empujan los límites del aprendizaje automático, los líderes de la industria advierten de una amenaza emergente: el cibercrimen habilitado por IA que podría superar a las defensas tradicionales. Mientras tanto, las empresas de hardware buscan entregar aceleradores más rápidos y más eficientes energéticamente, y los constructores de nubes y de centros de datos planean la próxima ola de capacidad para satisfacer la demanda creciente. En este panorama, las colaboraciones transfronterizas, los debates regulatorios y los ambiciosos programas industriales convergen para determinar cuán rápido puede implementarse la IA y a qué costo en seguridad y fiabilidad. Este reportaje sintetiza ideas de desarrollos en todo el ecosistema tecnológico, desde llamados a leyes más duras contra el cibercrimen hasta la aparición de plataformas modulares de desarrollo de IA, y desde grandes asociaciones de hardware hasta la ampliación de la huella de la infraestructura de IA en economías que se aceleran.

Las noticias sobre política y seguridad se agudizan cuando los expertos piden un marco legal contra el cibercrimen impulsado por IA. Los informes de Businessworld destacan una urgencia creciente entre los líderes de la industria para fortalecer las leyes y fomentar la cooperación internacional para frenar el fraude, el phishing y otros delitos alimentados por IA. Las propuestas van desde aclarar la responsabilidad por el engaño generado por IA hasta establecer normas mínimas para la protección de datos y los informes de incidentes, y crear mecanismos de intercambio de información transfronterizos que puedan acelerar las investigaciones. El debate surge mientras redes criminales explotan IA para crear mensajes de phishing altamente personalizados, deepfakes e identidades sintéticas. Los defensores argumentan que, sin regulaciones sólidas y armonizadas, los beneficios de la innovación habilitada por IA podrían verse erosionados por riesgos crecientes. Los críticos advierten que las leyes deben equilibrar seguridad con innovación, evitando sofocar la experimentación o imponer esquemas que dificulten la investigación y el despliegue legítimos. El objetivo general es alinear la política con los ritmos tecnológicos rápidos, asegurando que defensores, empresas y consumidores compartan un marco común.

Cientos de equipos de desarrollo están recurriendo a arquitecturas de IA modulares que prometen flujos de trabajo más confiables y escalables. La cobertura de Hackernoon sobre las actualizaciones del servidor MCP destaca cómo salidas estructuradas, técnicas de extracción de información y enlaces de recursos están convirtiéndose en parte integral de las operaciones modernas de LLM. El movimiento hacia pilas modulares, donde componentes especializados manejan la percepción, el razonamiento y la generación de salidas, permite a los desarrolladores recombinar capacidades rápidamente, probar alternativas y rastrear decisiones de forma más transparente. Los primeros adoptantes reportan ciclos de iteración más rápidos, mayor reproducibilidad y mejor integración con los ecosistemas de software existentes. Aunque gran parte de este contenido sigue estando detrás de muros de pago, la conclusión general es clara: un enfoque modular y auditable se está volviendo cada vez más esencial para navegar por el paisaje complejo y heterogéneo de las herramientas de IA en 2025.

Ilustración de flujos de trabajo de IA modulares, que reflejan la pila de estilo MCP formada por percepción, razonamiento y generación de salidas.

MIPS, una empresa muy observada por su hardware habilitado para IA, anunció la designación de Alan Li como Jefe de Desarrollo Comercial para China. El historial de Li en automoción, industria e infraestructura de comunicaciones se espera que acelere el crecimiento regional de MIPS y sus alianzas a medida que la demanda de aceleradores de IA en el borde se expande por Asia. El movimiento señala cómo los actores de hardware se están alineando con las ambiciones de IA a nivel nacional y regional, reforzando la tendencia hacia el despliegue coordinado y transfronterizo de capacidades de IA, desde las plantas de fabricación hasta las ciudades inteligentes, y destacando la importancia de asociaciones locales para navegar por marcos regulatorios y de mercado.

Alan Li, recién designado Jefe de Desarrollo Comercial para China en MIPS, señala una estrategia regional de hardware de IA intensificada.

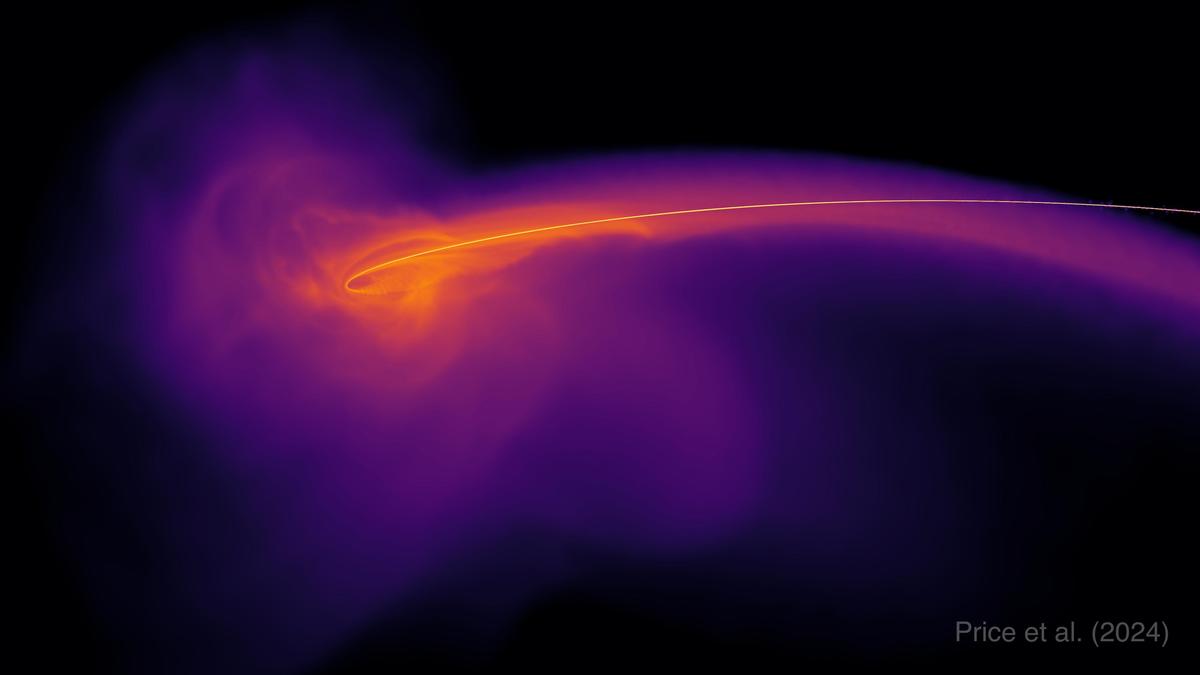

Más allá del laboratorio y del showroom, la ciencia subyacente a la IA y la computación continúa inspirándose en avances de la física fundamental. El informe de The Hindu sobre transitorios nucleares extremos cercanos a agujeros negros —donde las estrellas se estiran, desgarran y se energizan violentamente a medida que se acercan a los horizontes de eventos— subraya cómo fenómenos complejos y de alta energía exigen modelado y análisis de datos sofisticados. Aunque no es un artículo sobre IA per se, dicha ciencia ilustra la escala y la complejidad que los sistemas de IA buscan modelar, simular y acelerar. El cruce entre astrofísica, física cuántica y aprendizaje automático está ayudando a impulsar algoritmos novedosos, simulaciones mejoradas y una mejor comprensión del flujo de información en sistemas caóticos.

Simulaciones astrofísicas de procesos energéticos extremos cerca de agujeros negros — un recordatorio de los complejos problemas de datos que la IA busca resolver.

Hardware competition and collaboration remain at the heart of AI acceleration. One headline involves Nvidia’s potential collaboration with Samsung to advance AI chip technology and memory bandwidth through innovations like high-bandwidth memory (HBM) solutions. Another major strand is the partnership between Nvidia and Intel to co-develop multiple generations of custom datacenter and personal computing products, reflecting a broader strategy to diversify supply chains and ensure rapid deployment of AI workloads across enterprise and edge environments. These dynamics highlight how competitive pressures and strategic alliances are shaping the hardware stack that underpins modern AI—from GPUs to accelerators, memory, and system-integration capabilities.

NVIDIA y Samsung están avanzando en la tecnología de chips de IA, señalando una nueva fase en la competencia de hardware de IA.

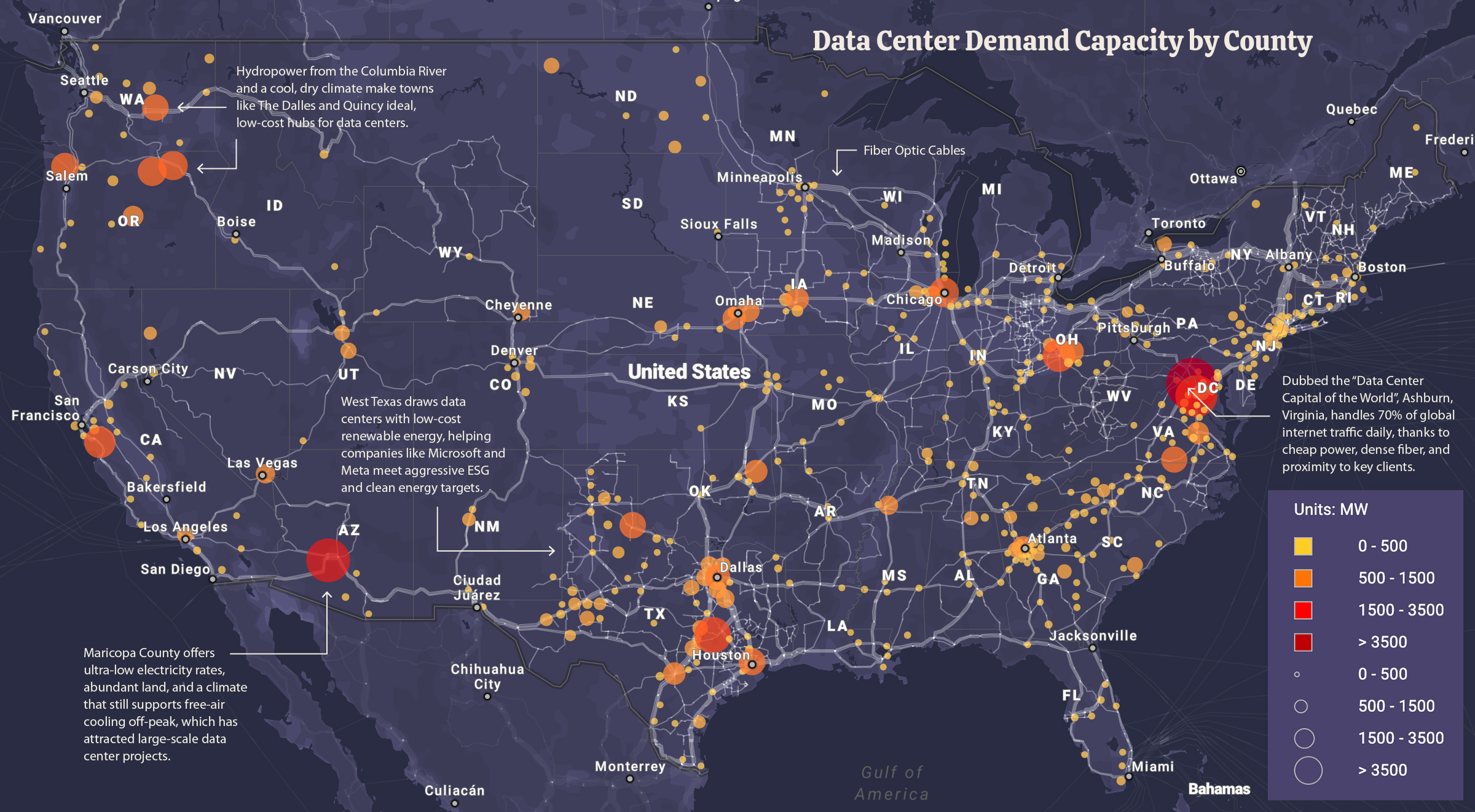

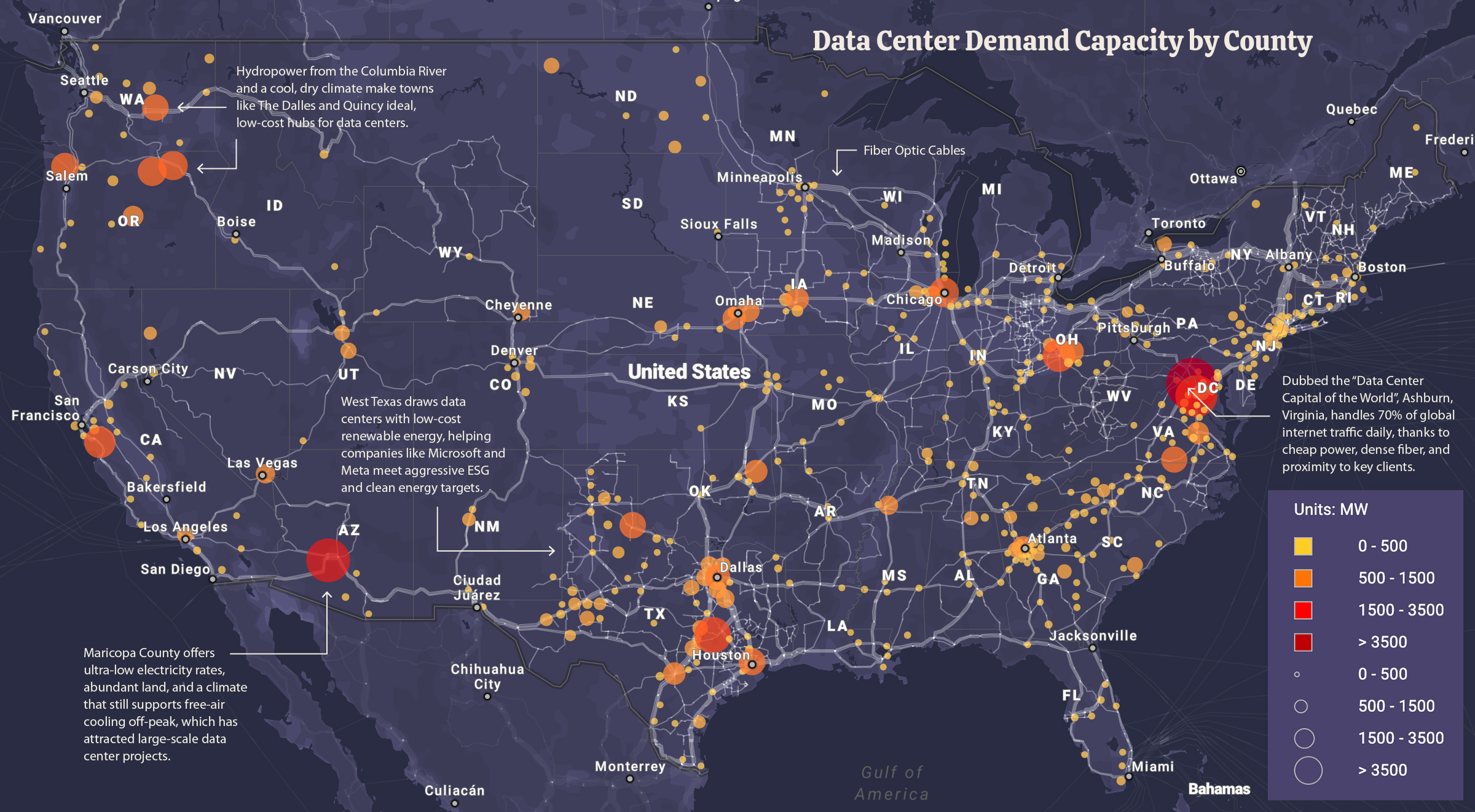

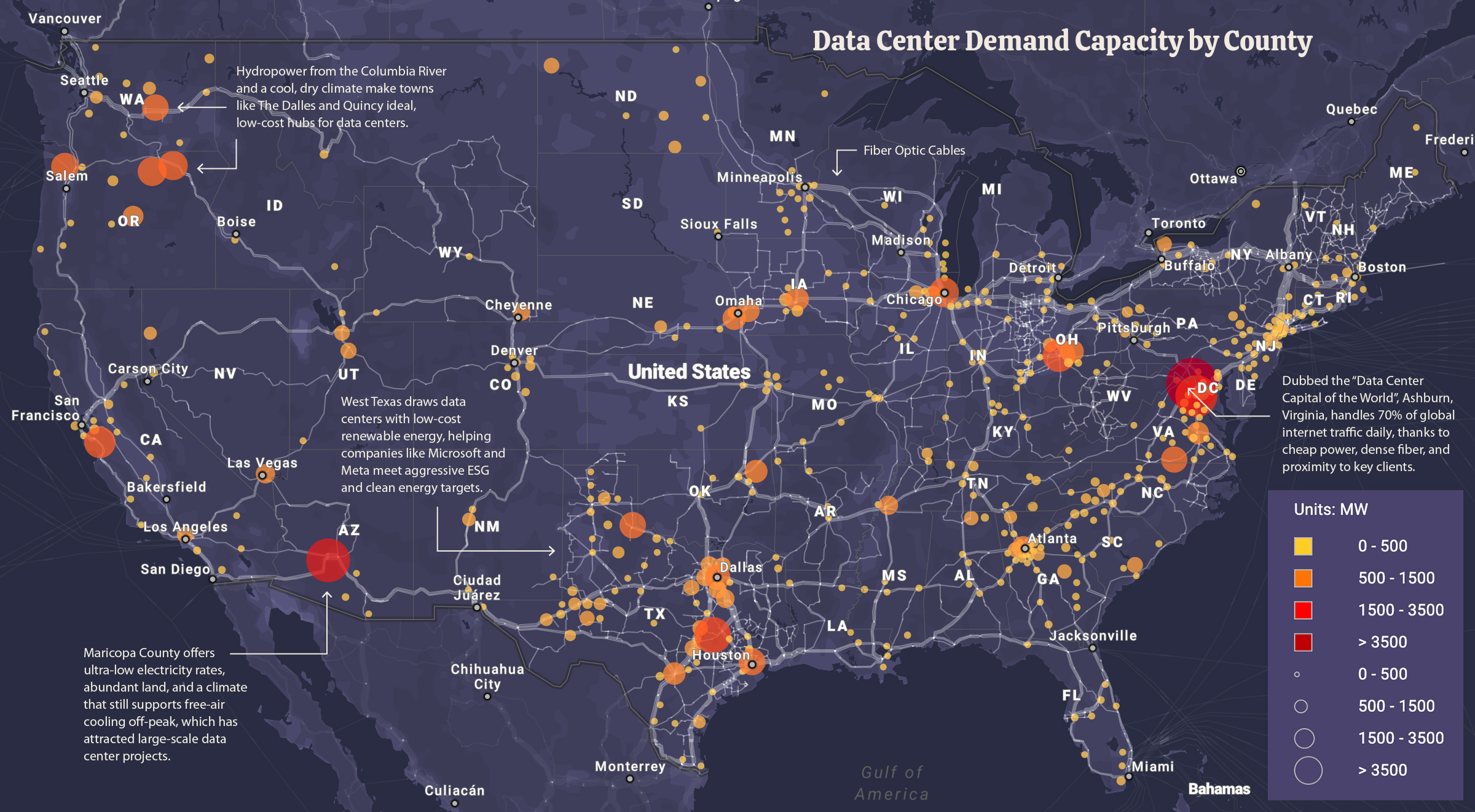

As organizations scale AI, data-center energy consumption has emerged as a critical constraint. Visual Capitalist’s data-center power map and related visualization, discussed in coverage of U.S. data-center energy use, highlights the enormous energy requirements behind modern AI. The information underscores the need for efficiency, wiser capacity planning, and smarter cooling, as data centers could see energy demand doubling by the end of this decade. The related analysis from FinancialContent aggregations also points to the geographic distribution of data-center activity and the strategic importance of location, grid reliability, and policy frameworks that incentivize clean energy and demand-response programs. In short, the infrastructure that makes AI possible is also demanding substantial electrical power, making energy efficiency a central competitive differentiator.

Un mapa que destaca la amplia huella de energía de los centros de datos que alimentan las cargas de IA en los Estados Unidos.

The United Kingdom’s ambitious AI infrastructure push is another major inflection point, with reports suggesting that Microsoft and Amazon are among the primary beneficiaries. The UK government’s sizable investment—on the order of tens of billions—aims to accelerate the deployment of AI-ready infrastructure, data centers, and cloud capacity. For multinational cloud players, this represents a potential rebalancing of cloud economics and a chance to expand regional service capabilities. The development also suggests new opportunities for local AI startups and research institutions to collaborate with global technology giants, leveraging a more connected, data-rich environment to accelerate experimentation and deployment across sectors such as health care, finance, and manufacturing.

Ilustración ilustrativa del desarrollo de infraestructura impulsada por IA y el crecimiento de centros de datos en el Reino Unido y Europa.

In the investment community, quantum computing remains a hot topic. The Fool’s discussion of three quantum computing stocks that could make a millionaire reflects the high-risk, high-reward nature of this frontier. While the technology promises exponential gains in solving certain classes of problems, investors should weigh valuation, execution risk, and the timeline for practical, large-scale quantum advantage. The broader takeaway is that quantum acceleration is increasingly considered part of the longer horizon for AI computing, with potential implications for optimization, materials science, cryptography, and beyond.

Las acciones de computación cuántica capturan la imaginación de los inversores a medida que las cargas de trabajo de IA se expanden hacia nuevos paradigmas computacionales.

The corporate AI-infrastructure landscape also features high-stakes collaborations among industry leaders. Global Legal Chronicle reports on NVIDIA and Intel’s collaboration to jointly develop multiple generations of custom datacenter and personal computing products, reflecting an enduring trend toward mega-deals and strategic alignments that aim to secure leadership across hardware, software, and services in AI ecosystems. Such alliances help diversify risk, accelerate product roadmaps, and standardize interfaces that enterprises rely on to deploy AI at scale.

Global Legal Chronicle coverage of a major NVIDIA–Intel collaboration on AI infrastructure.

Finally, the Indian AI market continues to garner attention from investors and builders alike. NetWeb Technologies’ reported fresh ₹450 crore order and bullish commentary from SEBI analysts signal strong momentum for AI-ready infrastructure providers in India. As AI workloads broaden from cloud data centers to regional campuses and edge deployments, local suppliers find opportunities in a rapidly expanding market with global demand. The Indian story complements the UK and US narratives, illustrating how AI-enabled growth is spreading across geographies with differing regulatory and market dynamics.

India’s AI infrastructure market gains traction as NetWeb Technologies secures a large order and analysts stay bullish.

As these threads weave together—policy safeguards, scalable modular AI architectures, strategic hardware partnerships, data-center growth, and expanding regional ecosystems—the 2025 tech landscape looks less like a single hype cycle and more like a coordinated effort to build robust, secure, and globally interconnected AI capabilities. The coming years will test whether all these pieces can align: regulations that deter misuse, hardware and software ecosystems that accelerate innovation, and energy and grid infrastructure capable of supporting a digital economy that relies on AI to drive productivity across industries.